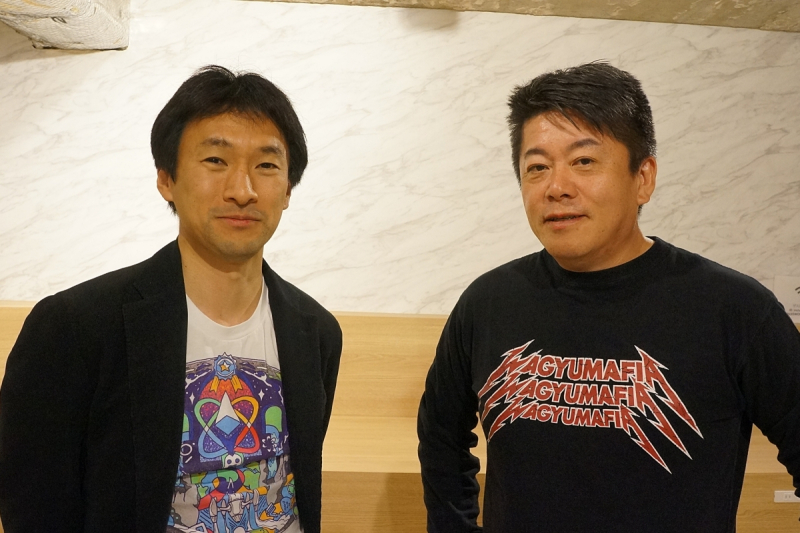

公益社団法人「Well-being for Planet Earth」理事でハーバード発の量子コンピュータースタートアップ企業の顧問も務める北川拓也。堀江氏はChatGPTが世間を騒がせている今、注目されるAI技術の未来について、北川氏に、最新動向を聞いた。

「Google」ができなかったこと。人の“思い”が「ChatGPT」にはある。

堀江貴文(以下、堀江) 本日は、よろしくお願いします。

北川拓也(以下、北川) こちらこそ、よろしくお願いします。まず、AI(人工知能)の話からしたいんですが、「OpenAI(人工知能研究所)」が「ChatGPT(対話型チャットサービス)」を作れて、「Google」がなぜ作れなかったのかという疑問がありまして。

堀江 はい。

北川 それは、OpenAIが「こうあってほしい」と感じる人の“思い”をChatGPTに入れたからだと言われているんですよ。

堀江 なるほど。AIに「こう振る舞ってほしい」と指示すれば、AIはそう振る舞いますよね。

北川 そうです。性能だけを比べたら、別にGoogleが劣っているわけではないんです。でも、OpenAIは「人はこういう振る舞い方をされたら喜ぶ」「こういう言い方をしたら賢いと感じる」ということをChatGPTに指示した。

堀江 はい。

北川 それから、もうひとつ。友達と話をしていてすごく興奮した仮説があるんです。AIの賢さ(精度)は、ある時点で急激に上がりました。では、その時点でAIは何を学んだのか?

堀江 はいはいはい。

北川 それまで「AIは因果関係がわからないから賢くないんだ」と言われていたんです。ですから、AIが因果関係を学んだ瞬間に賢さが急激に上がったんじゃないかと思ったんです。では、AIはどのように因果関係を学んだのか。例えば、賢さが上がる前のAIに「数学の定理を証明してください」と聞いたときの精度は30%程度でした。でも、「数学の定理の証明をステップバイステップで段階的に説明してください」と聞くと精度が90%くらいにグンと上がったんです。それで、その理由を考えてみたら「AIって時間の概念を持っていない」からだと思ったんですよ。

堀江 確かに。

北川 時間軸がないと因果関係を学びようがないんです。AIの頭の中に因果関係を読み取るだけの十分な情報があっても、「時間という概念を考えて説明しなさい」と指示をされていないと因果関係を考えない。でも、「段階的に説明しなさい」と時間の概念を含めて指示を出すと、因果関係を考えることができるようになった。まあ、これはあくまでも仮説ですが……。

堀江 じゃあ、AIは今、時間の概念を学んでいるかもしれないってことですね。

北川 はい。面白いでしょ。

堀江 面白いですね。例えば今の技術だと、自分とそっくりの顔のCGを作って、自分とそっくりの声を出させることができますよね。そして、それにChatGPTを入れると、もう普通に会話ができるようになる。

北川 そうですね。

Text=村上隆保 Photo=ZEROICHI

北川拓也(Takuya Kitagawa) 公益社団法人「Well-being for Planet Earth」理事

1985年生まれ。公益社団法人「Well-being for Planet Earth」理事。灘高卒業後、米ハーバード大学に進学。ハーバード大学院にて博士課程終了。理論物理学者。元楽天グループ常務執行役員CDOとして、グループ全体のAI/データを統括。ハーバード発の量子コンピュータースタートアップであるQuEra社の顧問も務める。